Inhaltsverzeichnis

Inhaltsseiten wie die AGB, Datenschutzerklärung oder Infos zum Widerrufsrecht von der Indexierung durch Suchmaschinen auszuschließen, ist in Gambio GX4 & GX5 deutlich einfacher als früher. Lediglich die robots.txt müssen Sie weiterhin händisch anpassen.

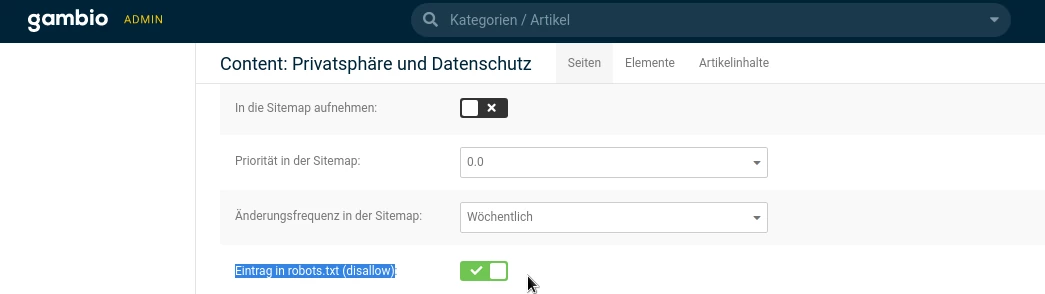

Eintrag in robots.txt (disallow)

An den Hintergründen, weshalb eine Seite nicht bei Google und anderen Suchmaschinen auffindbar sein soll, hat sich seit der Korrektur der robots.txt als SEO-Tipp für Gambio nichts geändert. Gehen wir exemplarisch davon aus, dass Sie Ihre Datenschutzerklärung nicht im Google-Index haben möchten. Die Grundlage hierfür schaffen Sie im Gambio-Admin unter Darstellung > Content Manager oder einfach durch Klick auf Content bearbeiten auf der entsprechenden Seite Ihres Shops.

Sofern nicht schon geschehen, aktivieren Sie die Option Eintrag in robots.txt (disallow). Auf diese Weise gekennzeichnete Inhaltsseiten gibt Gambio zukünftig mit einem HTTP-Header X-Robots-Tag: noindex,follow und dem äquivalenten Meta-Tag im HTML-Dokument aus. Dies ist die Grundlage dafür, Seiten von der Indexierung auszuschließen.

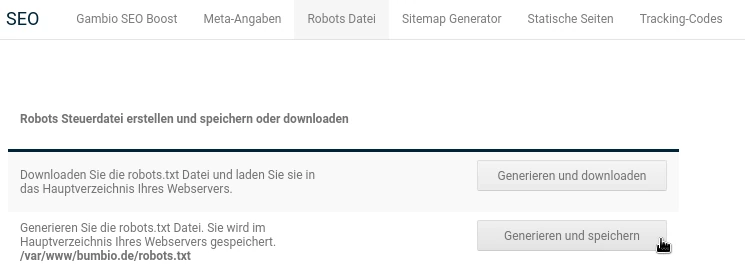

robots.txt anpassen

Wichtig ist jetzt nur noch, dass Google & Co. die Seite auch crawlen dürfen, um die noindex-Anweisung lesen zu können. Wenn Sie Gambios robots.txt-Generator unter Shop Einstellungen > SEO > Robots Datei nutzen, um die robots.txt-Datei zu generieren, enthält diese folgenden Eintrag:

Disallow: /info/privatsphaere-und-datenschutz.html

Wenn Ihr Shop in einem Unterverzeichnis namens shop installiert ist, sieht der Eintrag so aus:

Disallow: /shop/info/privatsphaere-und-datenschutz.html

Diese Zeile müssen Sie entfernen, damit Ihre Datenschutzerklärung unter privatsphaere-und-datenschutz.html nicht von Google, Bing & Co. indexiert wird.

Sicherheitsrisiko abschalten

Nach wie vor können Sie sich die Mühe des Entfernens einzelner Zeilen auch einfach sparen. Die robots.txt-Datei von Werbe-Markt.de sieht schlicht so aus und das hat mehrere gute Gründe:

User-agent: * Allow: / Sitemap: https://www.werbe-markt.de/sitemap_index.xml

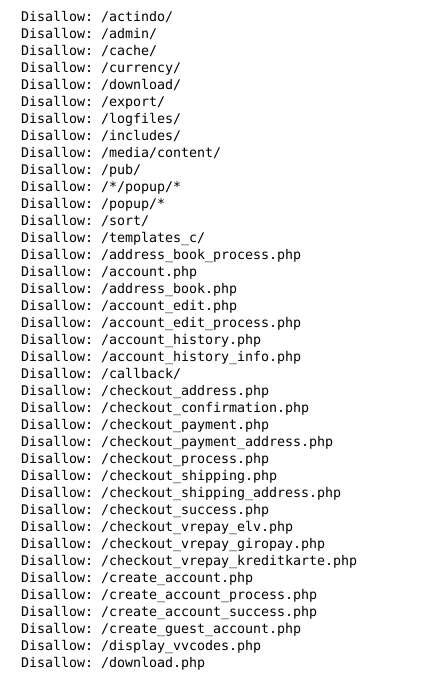

Eine öffentliche Auflistung von Dateien und Verzeichnissen, die man verstecken möchte, bewirkt das exakte Gegenteil und ist ein völlig unnötiges Sicherheitsrisiko. Wenn Ihnen ein Mensch oder eine Maschine Böses möchte, ist die robots.txt-Datei eine wunderbare erste Anlaufstelle.

Denn sie liefert eine übersichtliche Auflistung möglicher Angriffspunkte und sensibler Bereiche Ihres Onlineshops. Schnittstellen wie das actindo-Verzeichnis sind immer beliebte Angriffsziele. Dass das Backend über das admin-Verzeichnis erreichbar ist, ist für potenzielle Angreifer nicht schwer zu erraten. Aber man könnte sie es zumindest selbst herausfinden lassen, statt gleich in der robots.txt darauf hinzuweisen.

Versuchen Sie mal, als Hacker zu denken: „Was gibt es wohl für spannende Dateien im download-Verzeichnis? Wenn nicht direkt über das download-Verzeichnis, kann ich dann vielleicht über die download.php darauf zugreifen? Bestimmt geben mir die logfiles Aufschluss. Welche sensiblen Daten erwarten mich wohl im export-Verzeichnis?

Diese Art des Exhibitionismus ist ein absolutes No-Go… nicht aufgrund sittlicher, sondern sicherheitstechnischer Aspekte.

Indexierung verhindern

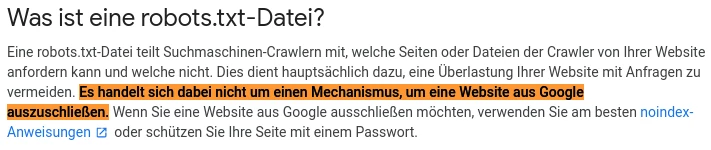

Kein Gambio-Blog-Beitrag zu dem Thema ohne den obligatorischen Hinweis: Wenn Sie eine Seite Ihres Onlineshops von der Indexierung durch Suchmaschinen ausschließen möchten, dürfen Sie deren Crawling nicht über die robots.txt-Datei blockieren. Damit verhindern Sie außerdem die unschöne Meldung in der Google Search Console:

Indexiert, obwohl durch robots.txt-Datei blockiert

Artikelseiten nicht indexieren

Oben geschilderte Vorgehensweise gilt für Inhaltsseiten. Um Artikelseiten nicht von Google & Co. indexieren zu lassen, verwenden Sie weiterhin das kostenlose Gambio-Modul NoSitemapNoIndex. Dieses ist nun bis einschließlich Gambio 4.1 kompatibel, kümmert sich um das X-Robots-Tag und entfernt zudem überflüssige Standardangaben aus dem Quelltext Ihres Onlineshops.